Nous pensons que chaque individu devrait pouvoir faire ses propres choix libres et éclairés en ligne. Amurabi s’engage donc dans la lutte contre les Dark Patterns.

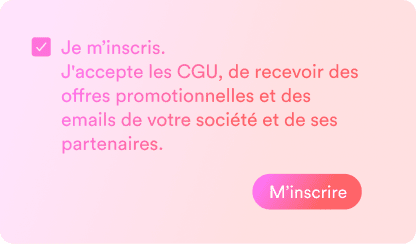

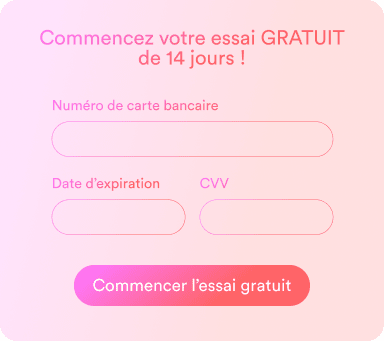

“J’accepte”. Qui n’a pas cliqué sans réfléchir sur le beau gros bouton bien vert, au lieu des petits liens gris en dessous ? Pire, qui aura réussi à se désabonner sans perdre son temps ni ses nerfs, alors qu’il avait suffit d’un clic pour “essayer gratuitement” ?

Ces interfaces ne doivent rien au hasard. Elles jouent sur nos biais cognitifs pour nous influencer, voire nous manipuler. Le phénomène des “dark patterns” ou “deceptive patterns” est endémique et mondial. La Commission européenne a démontré que 97% des sites e-commerce préférés des européens contiennent au moins un dark pattern. Aux Etats-Unis, une étude sur plus de 11000 sites a identifié plus de 1800 dark patterns.

Le terme “dark pattern” a été utilisé pour la 1ère fois par Harry Brignull, designer UX et docteur en neurosciences en 2010, pour désigner “des pièges sur les sites ou apps qui vous vous font agir sans le vouloir, comme acheter ou vous abonner à quelque chose”.

De nombreux chercheurs ont travaillé pour définir les dark patterns, créer des taxonomies c’est-à-dire des classifications, identifier les fondements juridiques qu’ils enfreignent et les façon de les réguler.

En termes généraux, on peut dire qu’un dark pattern est une interface qui trompe ou manipule les utilisateurs, pour les faire agir sans qu’ils s’en rendent compte ou même de façon contraire à leurs propres intérêts.

Bon à savoir

Plusieurs chercheurs préfèrent le terme “deceptive patterns” pour éviter tout malentendu sur une quelconque connotation péjorative associée au terme dark. Amurabi adhère pleinement à cette précaution, toutefois dans la mesure où les texte de loi mentionnent les “dark patterns”, nous utilisons ce terme pour plus de clarté.

Face au risques que font courir les dark patterns à tous les utilisateurs, et en particulier aux plus vulnérables, remettant en cause notre capacité à prendre des décisions autonomes en ligne, notre Lab de R&D s’est saisi du problème en 2021. Grâce à un financement de la BPI, nous avons créé une plateforme dédiée à la lutte contre les dark patterns, pour :

Identifier si votre site

ou votre app contient

des dark patterns

Créer des fair patterns

sur-mesure ou les acheter

sur étagère

Vous former pour les repérer, éviter

d’en créer de nouveaux,

que vous soyez designers, développeurs, marketeurs,

équipes produits

Certaines entreprises “parient” sur la manipulation des biais cognitifs de leurs clients, au lieu de la qualité de leurs produits ou services.

Kahneman, prix Nobel d’économie et expert en psychologie cognitive, a identifié que notre cerveau fonctionne de 2 manières principales :

Rapide, efficace et économe en énergie grâce au recours aux heuristiques – ces opérations mentales rapides et intuitives, pour prendre des décisions “sans réfléchir”

Plus lent, qui repose sur des stratégies analytiques, qui requiert un effort cognitif plus important.

Le Système 1 repose notamment sur nos biais cognitifs, sortes de « raccourci mental » qui se basent sur des informations incomplètes, irrationnelles ou faussées et nous font « agir sans réfléchir ». Plus de 180 biais cognitifs ont été identifiés

Les paramètres par défaut sont contraires aux intérêts de l’utilisateur

Par exemple : cases pré-cochées, devoir accepter un ensemble de paramètres sans pouvoir les individualiser, formulation du type « Tout accepter » sans possibilité de délimiter.

Divulgation sélective d’informations

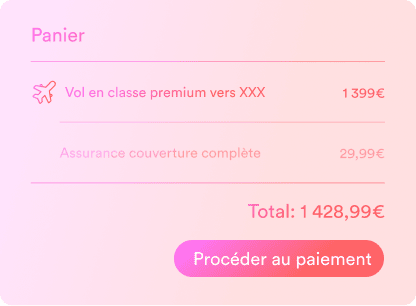

Par exemple : se faufiler dans le panier (ajout de produits sans action de l’utilisateur), coûts cachés, continuité forcée (renouvellement automatique après la période d’essai gratuite), publicité camouflée.

Faire en sorte que les utilisateurs fassent plus et/ou partagent plus qu’ils ne le souhaitaient

Par exemple : les utilisateur finissent par acheter un service auquel ils en n’avaient pas l’intention (sélection de siège) ou finissent par s’abonner alors qu’ils pensaient faire un achat ponctuel ou « essayer gratuitement » ou « consentir » à partager plus de données qu’ils ne le souhaitaient .

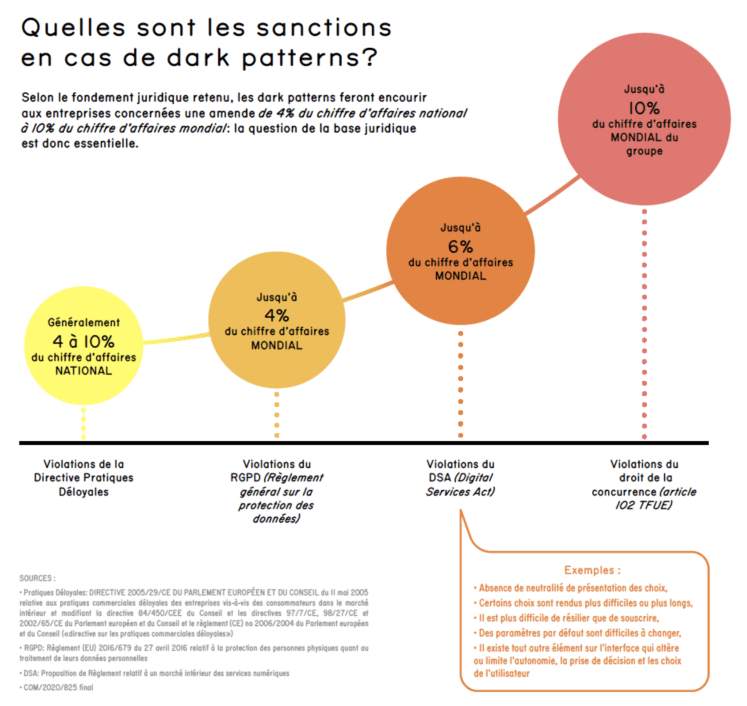

Les régulateurs et législateurs en Europe et dans le monde ont pris la mesure du danger pour la confiance dans l’économie numérique, voire dans l’économie de marché tout court. Des interdictions spécifiques voient le jour, comme le Digital Services Act, ou le Digital Market Act, en complément de l’arsenal législatif existant en droit des données personnelles, de la consommation et de la concurrence.

Par exemple, le règlement européen sur les services numériques (“DSA”), interdit pour la première fois en Europe – expressément et dans un texte contraignant – les “dark patterns”. Le DSA les définit comme: une interface digitale qui “trompe, manipule, altère ou limite sensiblement la capacité des utilisateurs à prendre des décisions libres et éclairées”, en raison de son “design, de son organisation ou de la façon dont elle est opérée.”

Cette interdiction spécifique vient compléter les fondements existants sur lesquels les dark patterns peuvent être interdits, comme par exemple le RGPD, la Directive Pratiques Déloyales au sein de l’Union et la Section 5 du FTC Act aux Etats-Unis ou encore le droit de la concurrence en Europe et aux Etats-Unis.